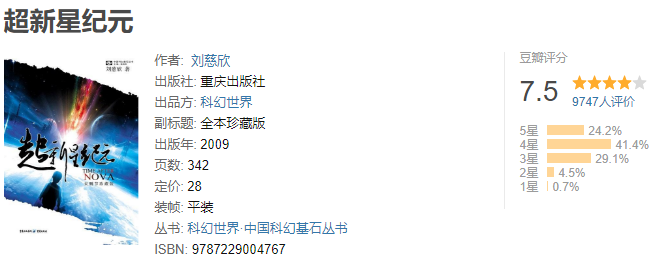

下面为谷歌搜索出的照片,左边是“工作非专业发型”,右边是“工作专业发型”。

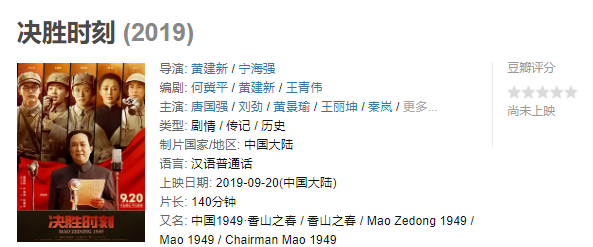

最近,工商管理硕士学生Rosalia发现了一件令人震惊的事情。在谷歌中输入“工作非专业发型”,搜索出的图片多是带有自然卷曲头发的黑人女性,而搜索“工作专业发型”时,则多为发型经过精心梳理的白人女性。

自此,Rosalia的推文得到了上千次转发——头24小时内就被转发了6200多次——这一发现引发了人们对职场黑人种族歧视的热烈讨论。计算机算法本身就是种族主义者?或者它只是反映了一种更广泛的社会现象。

将一个单词或短语输入谷歌图片搜索,不能即刻看到相应图片的日子,人们似乎已经很难想起了。据谷歌执行总裁Eric Schmidt说,谷歌于2000年正式引入这一功能,当时主要是为了满足大家突如其来却又势不可挡的需求。Jennifer Lopez身着一袭绿色深V范思哲礼服,所有人都想一睹其性感美姿。可以肯定的是,没有人想通过谷歌仅仅搜索其文字报道。

而如今,谷歌图片搜索实则已经成为我们无需自己动脑的一种上网方式,因为仅搜索一个单词、一个短语或查询,都会立即蹦出大批相关的图片。而且它还会为你“出谋划策”。如果你搜索“派”,你会看到整个或者切片的传统馅饼图片,以及一些可能的种类,苹果派?肉饼?或者你是在说数学字母π?谷歌图片搜索会为你将一切考虑周全。

我们总是被那些神秘却客观、只顺从我们意愿和珍贵信息逻辑的搜索引擎欺骗。跟随互联网出现的老式引擎反映了这一点:记得“Ask Jeeves”搜索引擎吧,那位极有教养的管家?还有那个“无所不搜”的Dogpile元引擎?尽管它们很神奇,但是引擎和计算机算法能够知道并搜索的内容都是受我们给它们输入的影响,也就是说他们反映的正是我们自己的偏见歧视。

在基本层面上,谷歌图片搜索首先会通过判断文本和周边的题注,计算出图片应该展示的人物和内容。可能还会包含一些基础的图片分析,将人脸与风景区别开来。在这场激烈的发型争论中,谷歌图片搜索显示出的“非专业发型”黑人女性的图片似乎多来自博客、文章和Pinterest网站平台。其中大多数都是讨论和抗议发型种族歧视的有色人群(多指黑人)明确提出的。一张图片链接到了“谴责汉普顿大学禁止留雷鬼头(乱蓬蓬的发辨)和玉米排辨”的帖子,另外一张则链接到“拥护自然卷发,办公室拉直头发的要求荒谬可笑”的帖子;拒绝接受“大波浪天生卷曲的头发会使新闻编辑室的人分心”这一说法。

最重要的是,算法只是反射出“非专业发型”偏见,并没有做出裁决。仅在Rosalia的推文如病毒一般扩散开的一天时间里,各种矛盾对立的帖子、推特本身的截图以及其它最近相关的图片都涌现到了谷歌图片搜索“非专业发型”的首位。但问题是在我们使用互联网过程中算法究竟扮演了什么样的角色,那乌托邦式梦幻的互联网是否仍完整不破。

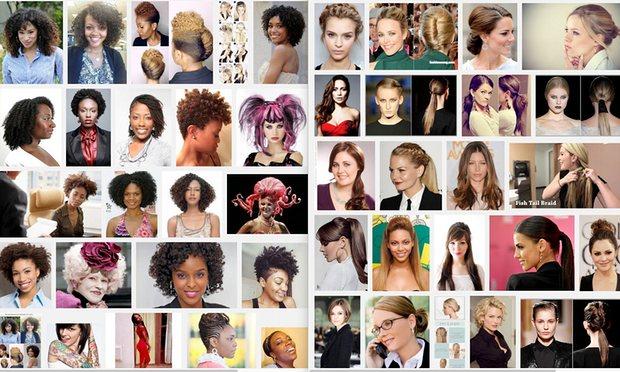

谷歌图片搜索出的男人(左)和女人(右)

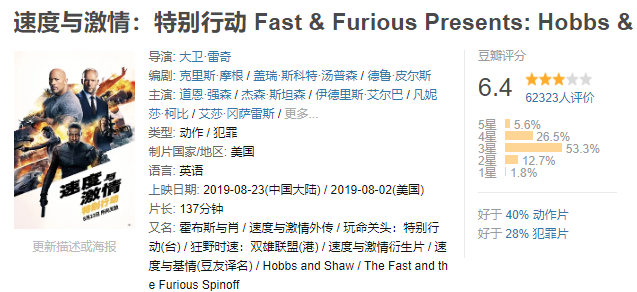

例如,搜索单词“男人”时,你看到的图片几乎全是白人,虽然是不同年龄的白人。搜索单词“女人”时,看到的同样多是年轻白人女性。考虑到全球人口中的大多数女性并不是白人,我们便可以立即看出白人、以西方为中心的偏见——从种族性别歧视到美与价值的文化标准——是如何操控了整个网络,以及这种网络所呈现出的人类故事。

当然,这并不是说算法就带有帝国主义色彩。它只是被设计成这个样子:展现的是它所具有的内容。但是作为“伟大平衡器”的网络现在看来也只是梦想,向我们展示世界实际尺寸和范围的真正非评判性、世界数字仆人仍是未实现的梦幻。

谷歌有什么办法“解决问题”吗,或许可以对图片进行标记、分先后次序?如果是的话,它应该这样吗?这些问题都指向“搜索”作为数字概念的特殊同一性:它的目的是反映和加强用户感受、行为和信仰的吗?抑或为了向我们完整展示这个世界的真实模样?谷歌图片搜索当初的设想是展现人们最想看到的一切。或许它对我们最想看到的到底是什么还是摸不着头脑。

(下载iPhone或Android应用“经理人分享”,一个只为职业精英人群提供优质知识服务的分享平台。不做单纯的资讯推送,致力于成为你的私人智库。)

作者:Leigh Alexander 译者 Echo_11

来源:译言网