![D%1ZVMVNC{`}7S95~]AOB)8.jpg](http://static.managershare.com/uploads/2016/01/1453691157842178.jpg)

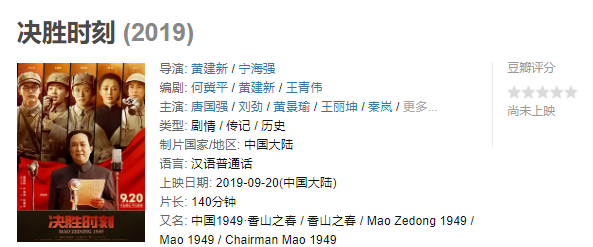

毕加索(Pablo Picasso)曾经说过:“计算机没什么用。它们只会给你答案。”

这位西班牙艺术家的笑谈或许符合20世纪的实情,那时计算机在很大程度上是强化版的计算器,用于执行明确界定的功能。但是,21世纪初计算能力的扩展意味着,计算机现在提出了我们这个时代一些最棘手的问题。而且目前还不清楚由谁负责提供答案。

人工智能、生物科技、纳米技术、机器人技术和神经系统科学等领域的技术进步,促使政策制定者、商界人士和消费者急于弄清楚它们在社会、经济和道德层面的全面潜在影响。

不妨只考虑三个问题。第一个是,人工智能是否像埃隆•马斯克(Elon Musk)所说的那样,“可能比核武器还要危险”?

几十年来,失控机器人摧毁其创造者的想法,一直是科幻小说的一个热门话题。但现在,一些严肃的科学家(比如史蒂芬•霍金(Stephen Hawking))以及知名的科技企业家(包括执掌特斯拉汽车(Tesla Motors)和SpaceX的马斯克)都对此表达了担忧。

我们如何才能确保人工智能被用于仁义目的、而不是非道德目的?足以威胁人类生命的超级智能即使真会出现,看来也至少是几十年以后的事情。

2015年年底,马斯克、彼得•蒂尔(Peter Thiel)以及硅谷其他一些企业家承诺投入10亿美元,创立非盈利公司OpenAI,其宗旨是保证人工智能一直是“个体人类意志的延伸”。

“很难设想人类水平的人工智能可能怎样造福于社会,同样难以想象的是,如果构建或使用不当,它可能对社会产生多大危害,”OpenAI的创始人在一篇博文中写道。

马斯克还向位于马塞诸塞州剑桥的未来生活研究所(Future of Life Institute)捐赠了1000万美元。该所正在研究人工智能在社会和伦理层面的影响。

该所的使命宣言是这么说的:“技术正给人类带来前所未有的潜能,让他们绽放才华……或者自我毁灭。让我们来扭转乾坤吧。”

第二个难题是,如何在自动驾驶汽车中植入“伦理弹性”?无论是好事还是坏事,人类驾驶员在评判不同情景的伦理时具有无限的灵活性——比如,违反“不得超车”规则,以便让骑自行车的人享有更大路面空间。但是,我们应当对自动驾驶汽车如何编程,使其在遇到真正危机时做出正确反应?我们应当为车主提供可调整的伦理设置吗?

在去年的一次演讲中,德国汽车制造商戴姆勒(Daimler)的首席执行官蔡澈(Dieter Zetsche)问道,“如果一场事故真的无法避免,而唯一选择是撞上一辆小汽车还是一辆大卡车、驶入沟渠还是撞上一堵墙,或者冒险沿边擦过推着婴儿车的妈妈还是80岁的老奶奶时”,自动驾驶汽车应该怎么做?

自2012年以来,戴姆勒和奔驰基金会(Daimler and Benz Foundation)已支出逾150万欧元,支持一个由20名科学家组成的团队,研究自动驾驶的社会影响以及由此引发的一些伦理难题。

这样的问题以前是道德哲学家研究的领域,比如哈佛大学的迈克尔• 桑德尔(Michael Sandel)曾经探讨的课题:“谋杀会是合理的吗?” 但现在,公司董事们和车主或许日益发现,自己不得不辩论伊曼努尔•康德(Immanuel Kant)的绝对命令(Categorical Imperative)与杰里米•边沁(Jeremy Bentham)的功利主义(utilitarianism,又称效用主义)的利弊。

医疗领域的进步也带来新的难题。我们应当禁止普通用户服用增强认知能力的药物吗?神经学家芭芭拉•萨哈金(Barbara Sahakian)和杰米•尼科尔•拉布泽塔(Jamie Nicole LaBuzetta)在《Bad Moves》一书中,特别提到了使用“聪明药”提升学习成绩的道德挑战。

他们问道,为何我们对那些服用类固醇以便在奥运会比赛中获得好成绩的运动员的看法那么差,却忽视了那些即将参加高考的学生服用“聪明药”提高成绩的行为?

北卡罗来纳州杜克大学(Duke University)的学生已向当局施压,要求修改该校的学术诚信政策,把“未经授权服用处方药”视为作弊。但似乎很少有其他大学或雇主考虑过这一难题。

“这些药物潜在可能使社会发生戏剧性的、意想不到的变化,”萨哈金和拉布泽塔在他们的书中写道,“现在是时候对这些‘聪明药’涉及的道德问题以及它们应当在未来社会扮演什么角色进行理性的讨论和辩论了,”他们总结道。

在所有这些让人困惑的问题背后,隐藏着一个大得多的问题:谁负责确保最新的技术成果不被滥用?

民族国家的政府和议会,都在忙于解决财政紧缩或难民流入等紧迫得多的问题,基本没有政治余力考虑如此抽象的挑战,更别提帮助设定国际标准或法规了。

就像其他众多领域一样,法规滞后于现实似乎是不可避免的。况且,有什么办法阻止流氓国家罔顾任何国际准则、把基因编辑、机器学习或网络技术用于毁灭性目的呢?

大学院系和智库机构已在传播知识和促进辩论方面发挥了有益作用。但它们经常依赖私人行业的资金支持,不太可能拿出将会严重制约捐款方的彻底的解决方案。

这基本上意味着让科技公司自我监管。在理解技术的潜在危险、并采取措施反制这些危险方面,有些科技公司处于遥遥领先的最有利地位。谷歌(Google)等公司开始成立伦理委员会,帮助监督本公司在人工智能等领域的活动。

但是,正如我们在2008年金融危机之前所看到的那样,私人部门机构往往会躲在对法律的狭义解读背后。

有些银行也被证明善于进行国际法律和监管套利。

打法律的“擦边球”明显破坏了道德标准,并在整个金融行业导致了不端行为。路透(Reuters)汇编的数据显示,到去年夏天,金融机构因为违反监管规定而支付的罚金已超过2350亿美元。

正如一名前银行家所说:“并非所有合法的事情都是合乎道德的。”

这是科技公司将不得不面对的一个问题——如果它们不希望所在行业在未来受到监管整顿的话。

译者/邢嵬

(下载iPhone或Android应用“经理人分享”,一个只为职业精英人群提供优质知识服务的分享平台。不做单纯的资讯推送,致力于成为你的私人智库。)

作者:英国《金融时报》 约翰•桑希尔

来源:FT中文网